LangChain — это фреймворк для разработки приложений с использованием больших языковых моделей, предоставляющий инструменты для создания агентов, работы с векторными хранилищами и прочего. Основной его интерфейс –

Ключевой особенностью LangChain является язык выражений LangChain (LCEL), позволяющий строить цепочки обработки данных, где выход одного этапа становится входом для следующего. Цепочки могут быть созданы с использованием

В LangChain важна работа с

Языковые модели в LangChain вызываются через интерфейс

Runnable, поддерживающий методы invoke, batch, и stream (и их асинхронные версии).

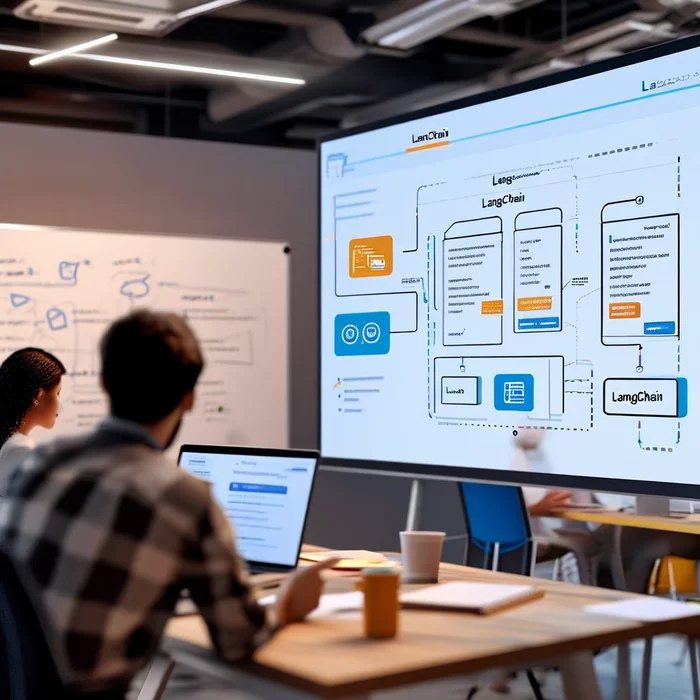

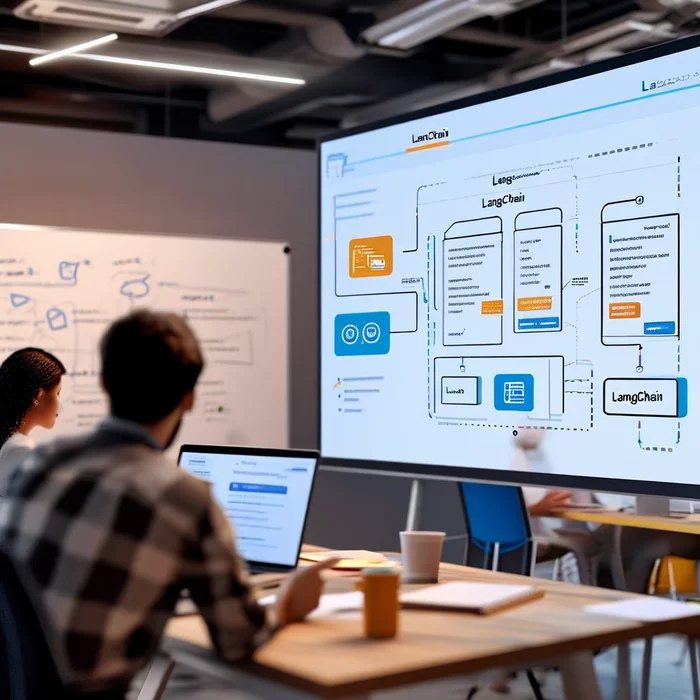

Изображение носит иллюстративный характер

Ключевой особенностью LangChain является язык выражений LangChain (LCEL), позволяющий строить цепочки обработки данных, где выход одного этапа становится входом для следующего. Цепочки могут быть созданы с использованием

RunnableSequence, оператора | или метода .pipe(). RunnableParallel позволяет запускать несколько этапов параллельно, передавая входные данные всем элементам. LCEL автоматически преобразует Python-функции в RunnableLambda, облегчая интеграцию кода. В LangChain важна работа с

Messages (сообщениями), которые передаются языковым моделям, и Prompt Templates (шаблонами подсказок), служащими для форматирования запросов к моделям. Шаблоны бывают нескольких видов, включая StringPromptTemplate для простых строк и ChatPromptTemplate для форматирования диалогов. MessagesPlaceholder используется для вставки списка сообщений. Языковые модели в LangChain вызываются через интерфейс

BaseLanguageModel, который является Runnable, что позволяет использовать методы, такие как invoke. Для работы с моделями Hugging Face используется пакет langchain-huggingface. Можно загружать модели локально через HuggingFacePipeline или использовать serverless API через HuggingFaceEndpoint. Цепочки prompt | model объединяют форматированный промпт с языковой моделью. Дополнительные методы, такие как with_retry, with_fallbacks, bind, RunnablePassthrough и assing расширяют возможности по обработке данных и добавлению новых параметров.