Журнал Royal Society Open Science 12 ноября опубликовал результаты исследования, проведенного под руководством Кэти Грей, доцента психологии из Университета Рединга в Великобритании. Работа, освещенная также ресурсом Live Science, поднимает проблему «гиперреализма» — феномена, при котором созданные искусственным интеллектом лица кажутся людям более настоящими, чем реальные человеческие лица. Эксперименты показали, что без инструктажа отличить подделку от оригинала практически невозможно даже для людей с исключительными способностями к восприятию лиц.

В исследовании сравнивались две группы участников: «типичные распознаватели» со средними способностями и «суперраспознаватели» — элитная группа, входящая в топ-2% населения по способности запоминать незнакомые лица. Добровольцы для экспериментов, включая суперраспознавателей, были набраны через базу данных Лаборатории распознавания лиц и голоса в Гринвиче. Целью ученых было проверить эффективность подхода «человек в контуре» (human-in-the-loop), объединяющего алгоритмы обнаружения ИИ и навыки обученных экспертов.

Технология создания дипфейков базируется на генеративно-состязательных сетях (GANs). Этот алгоритм состоит из двух этапов: генерации и дискриминации. Сначала система создает поддельное изображение на основе реальных фотографий, затем дискриминатор проверяет его на подлинность. Процесс повторяется циклично до тех пор, пока сгенерированное изображение не станет достаточно реалистичным, чтобы обмануть дискриминатор, что и приводит к появлению гиперреалистичных лиц.

В ходе первого эксперимента, который служил базовым уровнем, участникам давалось 10 секунд на то, чтобы определить, является ли лицо настоящим или созданным компьютером. Результаты оказались тревожными: суперраспознаватели смогли выявить лица ИИ только в 41% случаев, что даже хуже случайного угадывания. При этом они ошибочно принимали реальные лица за подделки в 39% случаев. Типичные распознаватели показали еще более низкий результат, выявив ИИ лишь в 30% случаев, и ошибались в оценке реальных лиц в 46% случаев, будучи склонными считать искусственные лица настоящими.

Ситуацию кардинально изменила короткая пятиминутная тренировка. Участникам объяснили специфические ошибки рендеринга, свойственные алгоритмам GAN. Ключевыми признаками подделки были названы: наличие «среднего зуба» (нарушение симметрии зубного ряда), странные линии роста волос, неестественная текстура кожи, а также чрезмерная пропорциональность черт лица — фейки часто выглядят более пропорциональными, чем живые люди. Обучение включало просмотр примеров, тест на 10 лицах с обратной связью и финальное повторение признаков ошибок.

Во втором эксперименте с новой группой участников после прохождения обучения показатели обнаружения значительно выросли. Суперраспознаватели смогли правильно идентифицировать лица ИИ в 64% случаев, снизив количество ошибок при оценке реальных лиц до 37%. Типичные распознаватели повысили точность обнаружения ИИ до 51%, хотя их показатель ложного определения реальных лиц как поддельных остался высоким — 49%.

Улучшение результатов сопровождалось изменением поведенческих паттернов: участникам потребовалось больше времени на принятие решений. Типичные распознаватели замедлились в среднем на 1,9 секунды, а суперраспознаватели — на 1,2 секунды. Это подтверждает гипотезу о том, что для выявления гиперреалистичных подделок необходимо сознательно замедляться и тщательно инспектировать подозрительные признаки, игнорируя первое интуитивное впечатление.

Майке Рамон, профессор прикладной науки о данных и эксперт по обработке лиц из Бернского университета прикладных наук в Швейцарии, выступила рецензентом работы. Она отметила методологические ограничения исследования: использование разных групп участников для первого и второго экспериментов (межсубъектный дизайн) вместо тестирования одних и тех же людей до и после обучения. Также остается неизвестным, сохраняется ли эффект от пятиминутного вмешательства в долгосрочной перспективе.

Поскольку суперраспознаватели улучшили свои показатели аналогично обычным людям, но изначально обладали более высокой способностью к обработке лиц, ученые предполагают, что они используют иные, дополнительные сигналы для идентификации, помимо явных ошибок рендеринга. Развитие технологий ИИ продолжается стремительно: уже существуют проекты по «оживлению» фотографий Амелии Эрхарт и Марии Кюри, а также генерации лиц на основе голоса. Однако это вызывает и этические вопросы, связанные с экологическими затратами на обучение моделей ради создания развлекательного контента, такого как «кот, едущий на банане».

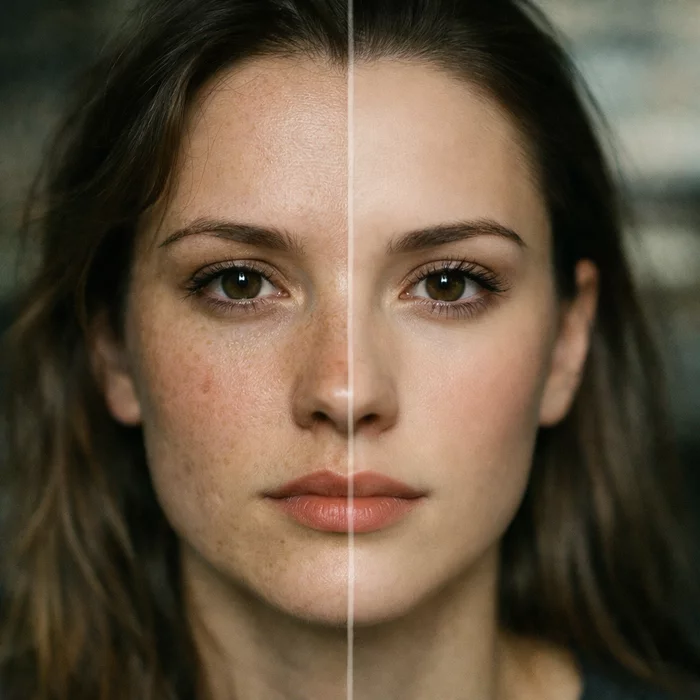

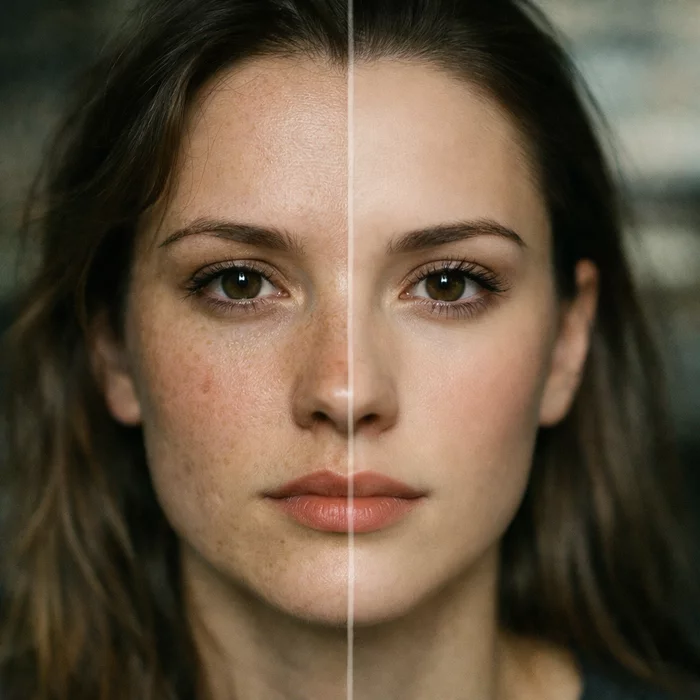

Изображение носит иллюстративный характер

В исследовании сравнивались две группы участников: «типичные распознаватели» со средними способностями и «суперраспознаватели» — элитная группа, входящая в топ-2% населения по способности запоминать незнакомые лица. Добровольцы для экспериментов, включая суперраспознавателей, были набраны через базу данных Лаборатории распознавания лиц и голоса в Гринвиче. Целью ученых было проверить эффективность подхода «человек в контуре» (human-in-the-loop), объединяющего алгоритмы обнаружения ИИ и навыки обученных экспертов.

Технология создания дипфейков базируется на генеративно-состязательных сетях (GANs). Этот алгоритм состоит из двух этапов: генерации и дискриминации. Сначала система создает поддельное изображение на основе реальных фотографий, затем дискриминатор проверяет его на подлинность. Процесс повторяется циклично до тех пор, пока сгенерированное изображение не станет достаточно реалистичным, чтобы обмануть дискриминатор, что и приводит к появлению гиперреалистичных лиц.

В ходе первого эксперимента, который служил базовым уровнем, участникам давалось 10 секунд на то, чтобы определить, является ли лицо настоящим или созданным компьютером. Результаты оказались тревожными: суперраспознаватели смогли выявить лица ИИ только в 41% случаев, что даже хуже случайного угадывания. При этом они ошибочно принимали реальные лица за подделки в 39% случаев. Типичные распознаватели показали еще более низкий результат, выявив ИИ лишь в 30% случаев, и ошибались в оценке реальных лиц в 46% случаев, будучи склонными считать искусственные лица настоящими.

Ситуацию кардинально изменила короткая пятиминутная тренировка. Участникам объяснили специфические ошибки рендеринга, свойственные алгоритмам GAN. Ключевыми признаками подделки были названы: наличие «среднего зуба» (нарушение симметрии зубного ряда), странные линии роста волос, неестественная текстура кожи, а также чрезмерная пропорциональность черт лица — фейки часто выглядят более пропорциональными, чем живые люди. Обучение включало просмотр примеров, тест на 10 лицах с обратной связью и финальное повторение признаков ошибок.

Во втором эксперименте с новой группой участников после прохождения обучения показатели обнаружения значительно выросли. Суперраспознаватели смогли правильно идентифицировать лица ИИ в 64% случаев, снизив количество ошибок при оценке реальных лиц до 37%. Типичные распознаватели повысили точность обнаружения ИИ до 51%, хотя их показатель ложного определения реальных лиц как поддельных остался высоким — 49%.

Улучшение результатов сопровождалось изменением поведенческих паттернов: участникам потребовалось больше времени на принятие решений. Типичные распознаватели замедлились в среднем на 1,9 секунды, а суперраспознаватели — на 1,2 секунды. Это подтверждает гипотезу о том, что для выявления гиперреалистичных подделок необходимо сознательно замедляться и тщательно инспектировать подозрительные признаки, игнорируя первое интуитивное впечатление.

Майке Рамон, профессор прикладной науки о данных и эксперт по обработке лиц из Бернского университета прикладных наук в Швейцарии, выступила рецензентом работы. Она отметила методологические ограничения исследования: использование разных групп участников для первого и второго экспериментов (межсубъектный дизайн) вместо тестирования одних и тех же людей до и после обучения. Также остается неизвестным, сохраняется ли эффект от пятиминутного вмешательства в долгосрочной перспективе.

Поскольку суперраспознаватели улучшили свои показатели аналогично обычным людям, но изначально обладали более высокой способностью к обработке лиц, ученые предполагают, что они используют иные, дополнительные сигналы для идентификации, помимо явных ошибок рендеринга. Развитие технологий ИИ продолжается стремительно: уже существуют проекты по «оживлению» фотографий Амелии Эрхарт и Марии Кюри, а также генерации лиц на основе голоса. Однако это вызывает и этические вопросы, связанные с экологическими затратами на обучение моделей ради создания развлекательного контента, такого как «кот, едущий на банане».